Recurrent Neural Network: Funktionsweise und Aufbau

Bei einem Recurrent Neural Network handelt es sich um ein Netz, das Rückkopplungen nutzen und so eine Art Gedächtnis erzeugen kann. Die Technik wird vor allem beim Umgang mit sequenziellen Daten angewendet und benötigt einen vergleichsweise hohen Trainingsaufwand.

Was ist ein Recurrent Neural Network?

Ein Recurrent Neural Network (RNN) ist ein künstliches neuronales Netzwerk, das in der Lage ist, Rückkopplungen zu erzeugen und so Ausgabeinformationen erneut als Eingabe einzuspeisen. Diese Methode kommt insbesondere bei der Verarbeitung sequenzieller Daten im Bereich Deep Learning und KI zum Einsatz. Im Deutschen spricht man auch von einem rückgekoppelten neuronalen Netzwerk. Durch die Informationsaufnahme aus früheren Eingaben entwickelt das Recurrent Neural Network eine Art Gedächtnis und verändert die Ausgabe je nach den vorherigen Elementen innerhalb einer Sequenz. Es gibt unterschiedliche Arten der Rückkopplung. Dadurch sind zwar auch die Möglichkeiten umfangreicher, das Training wird aber ebenfalls anspruchsvoller.

- In Sekunden zur Online-Präsenz

- Mehr Wachstum mit KI-Marketing

- Zeit und Ressourcen sparen

Wie funktionieren Recurrent Neural Networks?

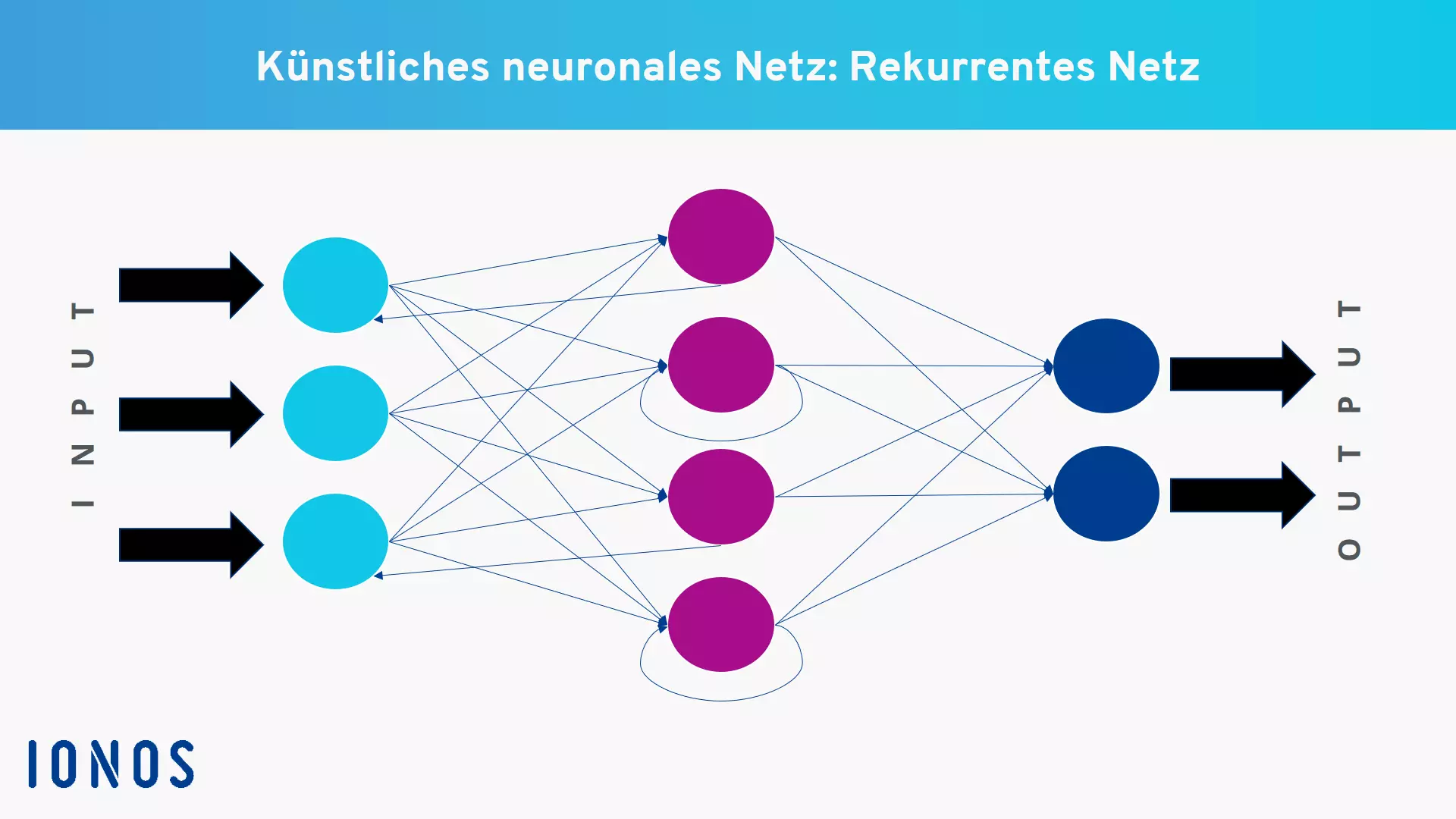

Auf den ersten Blick sind auch Recurrent Neural Networks so aufgebaut wie andere neuronale Netzwerke. Sie bestehen aus mindestens drei verschiedenen Schichten (engl. „layer“), die wiederum Neuronen (Knoten) enthalten, welche durch Kanten miteinander verbunden sind. Man spricht von der Eingangsschicht (Input Layer), einer Ausgangsschicht (Output Layer) und einer beliebigen Anzahl an Zwischenschichten, die auch als Hidden Layer bezeichnet werden.

- Eingangsschicht: In dieser Schicht werden Informationen aus der Außenwelt aufgenommen. Sie werden dann gewichtet und an die nächsthöhere Schicht weitergegeben.

- Zwischenschicht: Dabei handelt es sich um die Hidden Layer. Hier werden die Informationen weitergereicht und neu gewichtet. Dies passiert bei jeder zusätzlichen Schicht und im Verborgenen, weshalb man auch von versteckten Schichten spricht.

- Ausgangsschicht: Die Ausgabe der bewerteten oder modifizierten Information erfolgt dann über den Output Layer. Dieser Output ist entweder das Endergebnis oder dient als Eingabe für andere Neuronen.

Das Besondere an einem Recurrent Neural Network ist die Möglichkeit, die Richtung des Informationsflusses selbst zu bestimmen. Durch die Rückkopplung muss die Ausgabe eines Neurons nicht zwangsläufig an die nächsthöhere Schicht erfolgen, sondern kann auch als Eingabe des gleichen Neurons, eines Neurons in derselben Schicht oder eines Neurons in der vorherigen Schicht genutzt werden. Der Gewichtungsparameter ist dabei in jeder Schicht gleich. Die Rückkopplung wird in vier verschiedene Kategorien unterteilt:

- Direct Feedback: Bei einer direkten Rückkopplung wird der Ausgang des gleichen Neurons als Eingang genutzt.

- Indirect Feedback: Bei einer indirekten Rückkopplung wird der Ausgang eines Neurons mit einer vorherigen Schicht verbunden.

- Lateral Feedback: Bei einer seitlichen Rückkopplung wird der Ausgang eines Neurons mit dem Eingang eines anderen Neurons derselben Schicht verbunden.

- Vollständige Rückkopplung: Bei einer vollständigen Rückkopplung sind alle Neuronenausgänge mit anderen Neuronen verbunden.

Wie werden Recurrent Neural Networks trainiert?

Es ist deutlich komplizierter, Recurrent Neural Networks zu trainieren, da weit zurückliegende Informationen oftmals nicht oder nur unzureichend berücksichtigt werden können. Um dieses Problem zu beheben, wird häufig mit Funktionen wie Long Short-Term Memory (LSTM) gearbeitet. Dadurch werden Informationen länger gespeichert. Mit dem richtigen Training ist ein Recurrent Neural Network in der Lage, wichtige Informationen von unwichtigen zu unterscheiden und kann diese erneut ins Netz einspeisen.

Welche Architekturen gibt es?

Es gibt unterschiedliche Architekturen, die Recurrent Neural Networks voneinander unterscheiden. Dies sind die gängigsten Typen:

- One to many: Hierbei erhält das Recurrent Neural Network eine Eingabe und gibt mehrere Ausgaben zurück. Ein praktisches Beispiel dafür ist die Bildunterschrift, bei der ein Satz aus einem Schlüsselwort generiert wird.

- Many to one: Hierbei werden mehrere Eingänge einem einzigen Ausgang zugeordnet. Dieses Prinzip wird unter anderem bei der Stimmungsanalyse genutzt, bei der Feedback auf Basis von Referenzen vorhergesagt wird.

- Many to many: Hierbei nutzen Sie mehrere Eingaben um auch mehrere Ausgaben zu erhalten. Die Anzahl muss dabei nicht deckungsgleich sein. Genutzt wird die Technik zum Beispiel bei der Übersetzung von einer Sprache in eine andere.

- 100 % DSGVO-konform und sicher in Deutschland gehostet

- Die leistungsstärksten KI-Modelle auf einer Plattform

- Kein Vendor Lock-in durch Open Source

Was sind die wichtigsten Anwendungsgebiete eines Recurrent Neural Networks?

Recurrent Neural Networks sind insbesondere dann von Nutzen, wenn der Kontext bei der Informationsverarbeitung wichtig ist. Dies gilt insbesondere für den Umgang mit sequenziellen Daten, die eine bestimmte Reihenfolge oder zeitliche Abfolge haben. In solchen Fällen können RNNs durch den Kontext vorheriger Eingaben ein Ergebnis besser vorhersagen. Die Technik eignet sich daher unter anderem für folgende Anwendungsgebiete:

- Prognosen und Zeitreihendaten: RNNs werden häufig zur Vorhersage von Ereignissen oder Werten auf Basis historischer Daten eingesetzt, wie z.B. bei der Finanzmarktanalyse, Wettervorhersage oder dem Energieverbrauch.

- Natural Language Processing (NLP): Im Bereich der Verarbeitung natürlicher Sprache, also des Natural Language Processing, sind rekurrente neuronale Netzwerke besonders nützlich. Sie werden unter anderem für Aufgaben wie maschinelle Übersetzung, Sprachmodellierung, Texterkennung und automatische Textgenerierung verwendet.

- Spracherkennung: RNNs spielen eine entscheidende Rolle in der Spracherkennungstechnologie, wo sie verwendet werden, um gesprochene Sprache in Text zu konvertieren. Diese Anwendungen sind zum Beispiel in digitalen Assistenten und automatischen Transkriptionsdiensten zu finden.

- Bild- und Videoanalyse: Obwohl Recurrent Neural Networks hauptsächlich für die Verarbeitung von sequenziellen Daten verwendet werden, können sie auch in der Bild- und Videoanalyse eingesetzt werden, insbesondere wenn es um die Verarbeitung von Bildsequenzen oder Videos geht, wie bei der Videozusammenfassung oder der Erkennung von Aktivitäten in Überwachungsvideos.

Was ist der Unterschied zu einem Feedforward Neural Network?

Das Recurrent Neural Network ist eine Weiterentwicklung des Feedforward Neural Network (FNN), welches keine Rückkopplungen zulässt. Beim FNN fließen Informationen daher immer nur in eine Richtung zur nächsthöheren Schicht. Eine erneute rückwärtige Einspeisung ist somit nicht möglich. So kann das Feedforward Neural Network zwar Muster erkennen, dabei aber nicht auf bereits verarbeitete Informationen zurückgreifen.