Alte Webseiten aufrufen mit Wayback Machine und Co.

Oft besteht der Bedarf, alte Webseiten zu finden oder alte Internetseiten wiederherzustellen. Mithilfe von Tools wie der Wayback Machine, dem Google-Cache oder WebCite können Sie alte Webseiten aufrufen, alte Internetseiten wiederherstellen oder eine alte Homepage finden.

- Profi-Website in Sekunden dank KI

- Aus tausenden Vorlagen auswählen

- 30 Tage kostenlos testen

Warum kann es sinnvoll sein, alte Internetseiten wiederherzustellen?

- Offline-Seiten: Technische Probleme oder gekündigte Hosting-Dienste machen Inhalte unzugänglich – Archive sichern diese Inhalte. So lassen sich alte Webseiten aufrufen, auch wenn die Originalseite nicht mehr existiert.

- Recherche & Quellenprüfung: Journalisten, Blogger und Wissenschaftler können frühere Versionen nachprüfen und nachvollziehbar zitieren.

- SEO-Zwecke: Archivierte Inhalte helfen, Links zu prüfen, Änderungen zu dokumentieren und die Link-Power alter Domains zu nutzen.

- Rechtliche Beweissicherung: Screenshots und archivierte Inhalte dienen als Nachweis bei Beleidigungen, Bedrohungen oder Arbeitsrechtsprozessen.

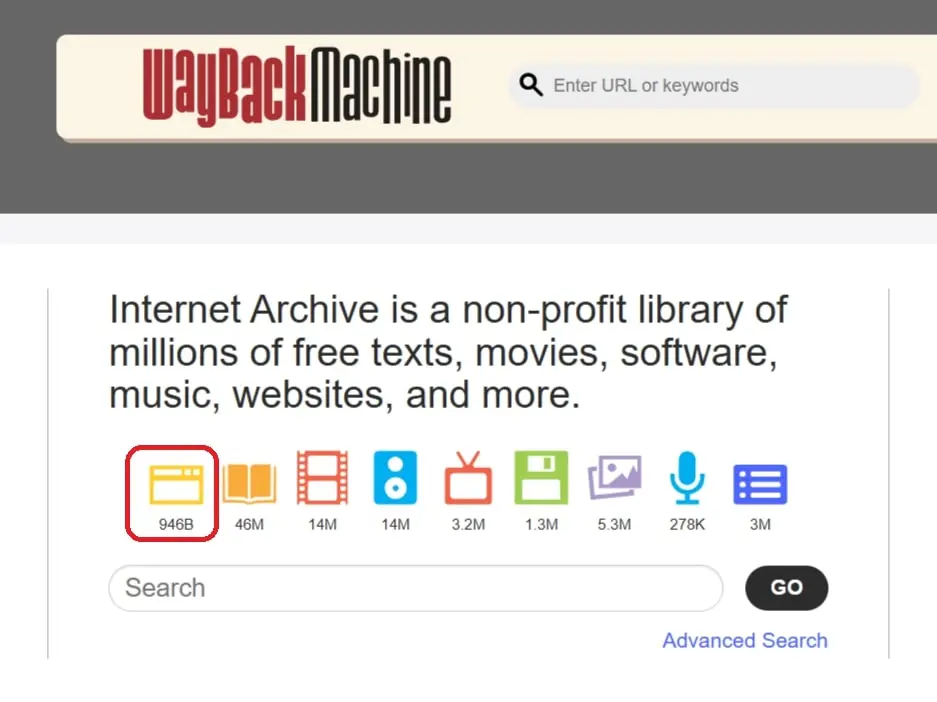

Internet-Archive-Projekt: Alte Internetseiten und mehr

Das Internet Archive ist ein Non-Profit-Projekt von Brewster Kahle, das seit 1996 digitale Inhalte archiviert. Kernstück ist die Wayback Machine, mit der Sie alte Webseiten aufrufen und historische Screenshots, Texte, Bilder oder Videos einsehen können. Die frühesten gespeicherten Websites stammen aus dem Jahr 1996. Die Wayback Machine enthält über 300 Milliarden archivierte Seiten. So lassen sich alte Internetseiten wiederherstellen und alte Webseiten finden.

Neben Webseiten sammelt das Internet Archive auch:

- Texte und Bücher

- Audioaufzeichnungen, darunter Live-Konzerte

- Videos und TV-Beiträge

- Bilder

- Software-Programme

Die Inhalte stammen aus dem Gemeingut oder werden von Rechteinhabern gespendet. Viele Inhalte kommen von Universitäten, Regierungsorganisationen oder Digitalisierungsprojekten wie Project Gutenberg und LibriVox.

Wayback-Machine-Tutorial: Alte Webseiten finden und archivieren

Wenn Inhalte Ihrer Website verloren gehen oder Sie frühere Versionen einer Seite einsehen möchten, hilft die Wayback Machine. In nur wenigen Schritten können Sie alte Webseiten wiederfinden, alte Internetseiten aufrufen und sogar eigene Seiten archivieren.

Schritt 1: URL direkt eingeben

Geben Sie die gewünschte Domain in die obere Suchleiste ein und drücken Sie Enter, um direkt zur Ergebnisseite zu gelangen.

Schritt 2: Wayback-Hauptseite aufrufen

Klicken Sie auf das gelbe Web-Icon, um zur Hauptseite zu gelangen. Dort können Sie eine Domain-URL eingeben und auf „Browse History“ klicken, um archivierte Versionen zu sehen.

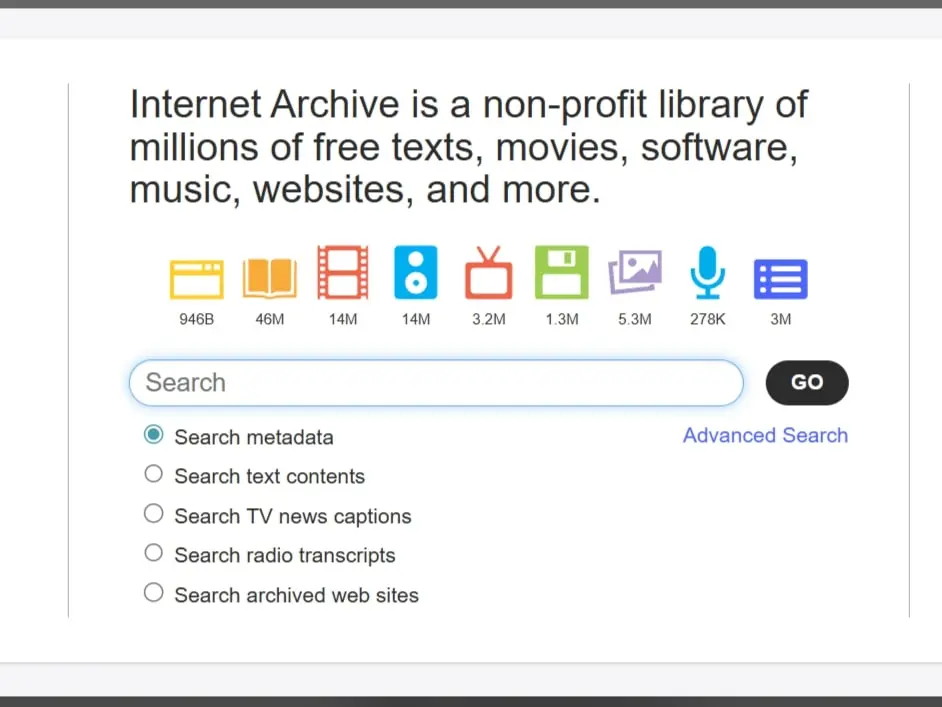

Schritt 3: Nach Stichworten suchen

Geben Sie einen Suchbegriff in die untere Suchleiste ein und wählen Sie „search archived web sites“. Klicken Sie auf „Go“, um die Trefferliste zu erhalten, die Domain, Beschreibung, Snapshots und Medienaufnahmen anzeigt.

Ein Snapshot ist eine Momentaufnahme einer Website. Dynamische Elemente wie Formulare funktionieren darin nicht, die Inhalte können aber gelesen oder kopiert werden.

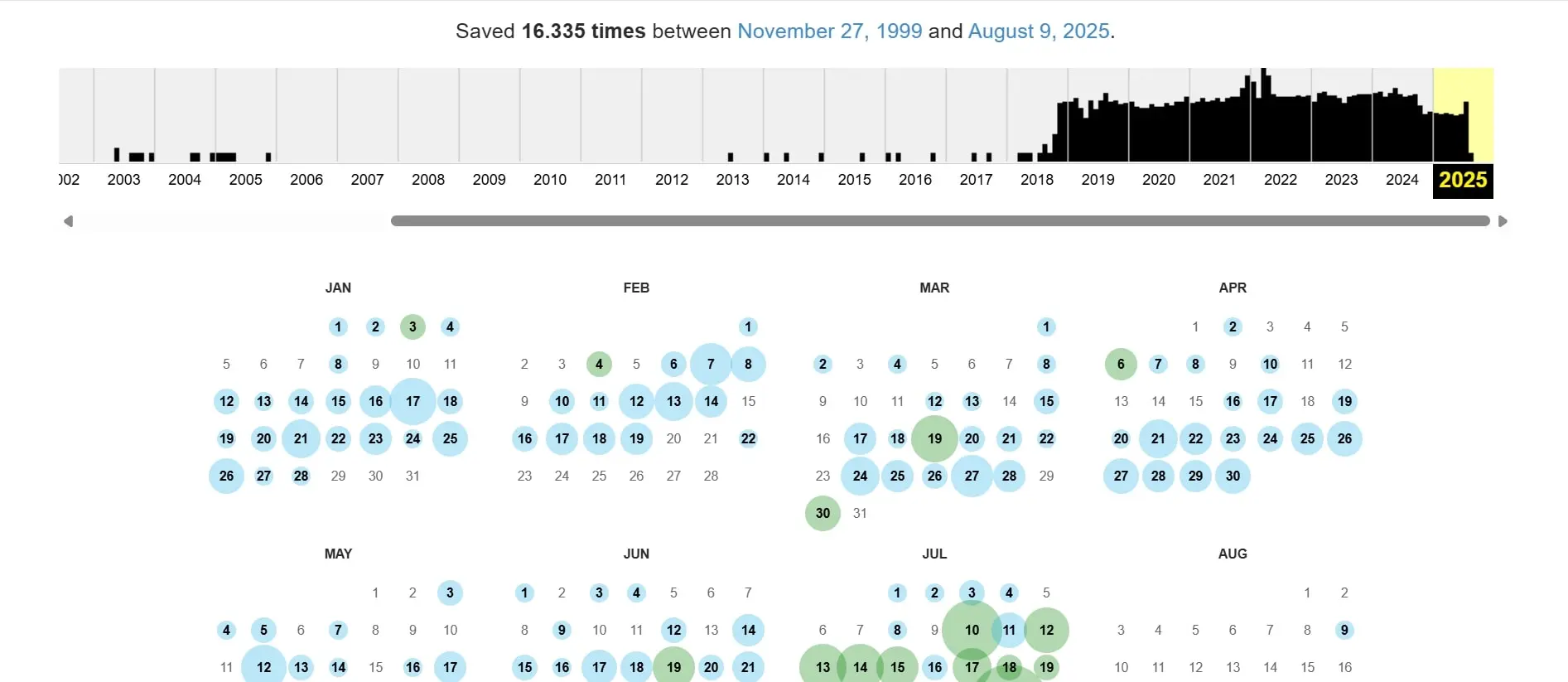

Schritt 4: Timeline und Snapshots nutzen

Für jede archivierte URL zeigt die Wayback Machine eine Timeline mit Säulen für die Anzahl der Snapshots pro Datum. In der Kalenderansicht sind die Snapshots farbcodiert:

- Blau: erfolgreicher Crawl

- Grün: Umleitungen

- Orange: nicht gefundene URL (4xx)

- Rot: Server-Fehler (5xx)

So nutzen Sie die Timeline:

- Klicken Sie auf ein farbig markiertes Datum.

- Wählen Sie den gewünschten Timestamp, um den Screenshot der archivierten Website zu sehen.

- Navigieren Sie innerhalb der Seite wie gewohnt und kopieren Sie Inhalte bei Bedarf.

Schritt 5: Eigene Website archivieren (Self-Snapshot)

Nicht jede Website wird automatisch archiviert. Gründe können sein:

- Ein

noindex-Tag oder ein entsprechender Eintrag in der robots.txt verhindern Indexierung - Passwortgeschützte Inhalte

- Manuelles Entfernen aus dem Archiv

- Dynamische Inhalte, die nicht korrekt erfasst werden

So sichern Sie Ihre Website:

- Gehen Sie zur Wayback Machine-Hauptseite.

- Nutzen Sie das Feld „Save Page Now“ und geben Sie Ihre Domain ein.

- Nach kurzer Zeit erstellt die Wayback Machine einen Snapshot, der dauerhaft gespeichert wird. So können Sie alte Webseiten aufrufen, auch wenn die Live-Seite später nicht mehr verfügbar ist.

Für weniger bekannte oder regionale Websites lohnt es sich, regelmäßig eigene Snapshots zu erstellen.

Wie lädt man alte Webseiten herunter?

Für die weitergehende Nutzung, z. B. Quellcode, Links oder SEO-Tests, gibt es Tools wie:

- Wayback-Machine-Downloader (GitHub, Open Source): Lädt HTML-Dateien, Medien und Index-Seiten herunter.

- Archivarix (Web-basiert): Kostenlos für Websites mit bis zu 200 Dateien; ZIP-Download nach Registrierung.

- HTTrack Website Copier: Klassisches Tool, um ganze Websites herunterzuladen (auch Archiv-Seiten, wenn Sie die Wayback-URLs angeben).

Archive.org selbst bietet keinen Website-Downloader an, erlaubt aber das Herunterladen von Texten, Bildern und Audiodateien, wenn die Rechte vorliegen.

Alternative 1: Nicht ganz so alte Webseiten finden – mit der Google-Suche

Ist die gesuchte Information noch relativ aktuell, kann eine einfache Google-Suche ausreichen. Google-Crawler erfassen Webseiten ähnlich wie die Wayback Machine und speichern einen Snapshot im Cache. Dieser zeigt die zuletzt indexierte Version der Seite. Fällt die Live-Webseite kurzzeitig aus, kann der Cache weiterhin genutzt werden. Im Vergleich zu archive.org ist dieser Snapshot oft aktueller, allerdings existiert nur ein Zeitpunkt (Timestamp) pro Version.

Um die gecachte Version einer Seite aufzurufen, können Sie direkt den folgenden Befehl in der Adresszeile Ihres Browsers verwenden:

http://webcache.googleusercontent.com/search?q=cache:https://www.DOMAIN.com

Dabei ersetzen SieDOMAIN.com durch die gewünschte URL. Beachten Sie, dass auch Google-Snapshots dynamische Elemente oder Medieninhalte größtenteils nicht anzeigen.

Selbst wenn eine Seite auf noindex gesetzt ist und nicht in den Suchergebnissen erscheint, kann der Cache manchmal noch eine ältere Version bereitstellen.

Alternative 2: Zugriff auf bereits archivierte Webseiten – mit WebCite

WebCite ermöglicht es, auf bereits archivierte Webseiten zuzugreifen und diese zu zitieren. Aktuell werden jedoch keine neuen Archivierungsanfragen mehr akzeptiert. Bereits archivierte Snapshots können weiterhin aufgerufen und in Quellenangaben genutzt werden. So lassen sich alte Internetseiten wiederherstellen und alte Webseiten aufrufen.

Um auf eine archivierte Version einer Website zuzugreifen, besuchen Sie die WebCite-Website und verwenden die Suchfunktion, um die Domain oder die Snapshot-ID einzugeben. So können Sie ältere Versionen von Webseiten einsehen, die bereits archiviert wurden, und diese unveränderbar als Quelle angeben.