Retrieval-Augmented Generation (RAG) – was ist das?

Retrieval-Augmented Generation (RAG) ist eine Technologie, die generative Sprachmodelle durch das Abrufen relevanter Informationen aus externen und internen Datenquellen verbessert, um präzisere und kontextuell relevante Antworten zu liefern. Wir stellen Ihnen das Konzept von RAG vor und erklären, wie Sie es in Ihrem Unternehmen richtig einsetzen können.

- In Sekunden zur Online-Präsenz

- Mehr Wachstum mit KI-Marketing

- Zeit und Ressourcen sparen

Was ist Retrieval-Augmented Generation?

Retrieval-Augmented Generation (RAG) ist eine Technologie zur Optimierung der Ausgabe eines großen Sprachmodells (LLM). Einfach ausgedrückt arbeitet RAG folgendermaßen: Infolge einer Benutzeranfrage durchsucht das System zunächst eine große Menge an externen Daten, um relevante Informationen zu finden. Dies kann eine interne Datenbank, das Internet oder eine andere Informationsquelle sein. Nachdem es die passenden Daten gefunden hat, nutzt das System fortschrittliche Algorithmen, um aus diesen Daten eine verständliche und präzise Antwort zu generieren.

Große Sprachmodelle (LLMs) sind essenziell für die Entwicklung von künstlichen Intelligenzen (KIs), insbesondere für intelligente Chatbots, die Anwendungen der natürlichen Sprachverarbeitung, auch Natural Language Processing genannt, nutzen. Ihr Hauptziel ist es, Bots zu schaffen, die Benutzerfragen in verschiedensten Kontexten präzise beantworten können, indem sie auf zuverlässige Wissensquellen zugreifen.

Trotz ihrer hohen Leistungsfähigkeit sind LLMs mit einigen Herausforderungen verbunden. Zum Beispiel kann es vorkommen, dass sie falsche Antworten geben, wenn keine passenden Informationen für eine Antwort vorliegen. Da sie aus großen Textmengen aus dem Internet und anderen Quellen lernen, übernehmen sie außerdem oft Vorurteile und Stereotypen, die in diesen Daten enthalten sind. Die Daten, auf denen sie trainiert wurden, sind zu einem festen Zeitpunkt gesammelt worden. Das bedeutet, ihr Wissen ist auf diesen Zeitpunkt begrenzt und wird nicht automatisch aktualisiert. Das kann dazu führen, dass veraltete Informationen an den Nutzer oder die Nutzerin ausgegeben werden.

Durch die Kombination von RAG mit LLMs können diese Einschränkungen überwunden werden. Retrieval-Augmented Generation ergänzt die Fähigkeiten von LLMs, indem es aktuelle und relevante Informationen findet und verarbeitet, was zu präziseren und verlässlicheren Antworten führt.

Wie funktioniert RAG?

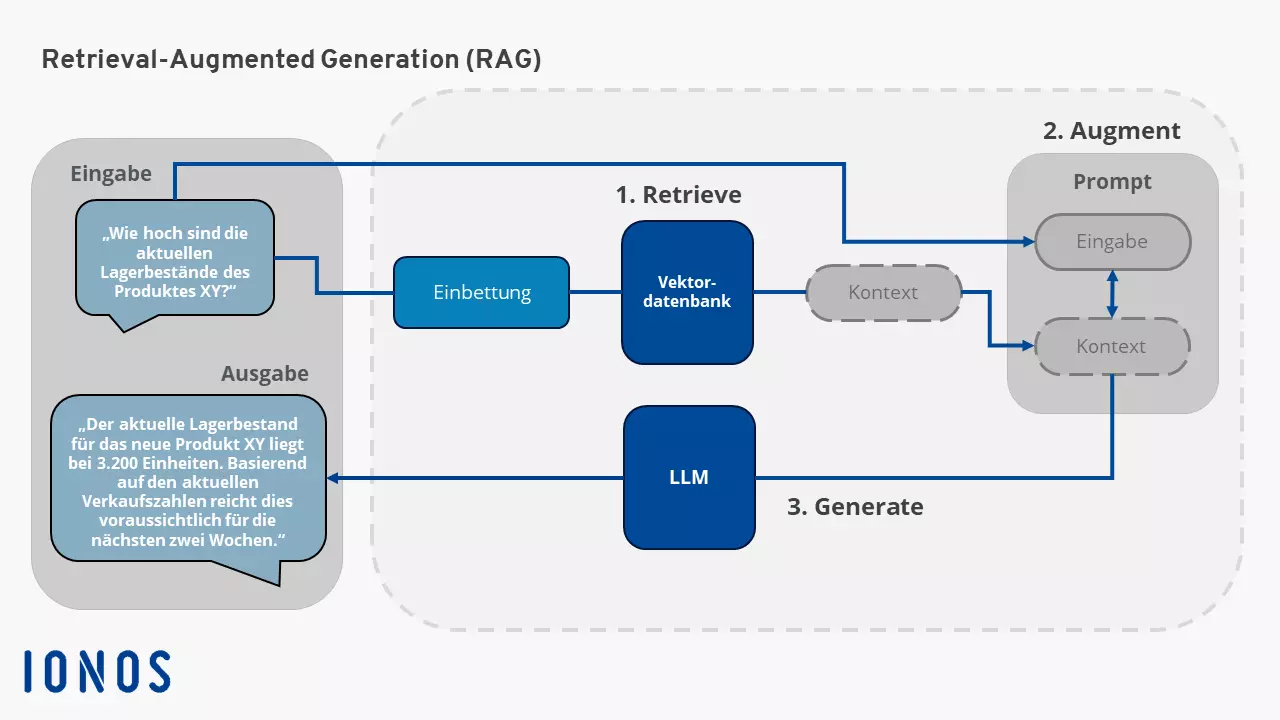

Die Retrieval-Augmented Generation arbeitet in mehreren Schritten, um präzise und nützliche Antworten zu liefern. Hier ist eine Schritt-für-Schritt-Erklärung, wie RAG funktioniert:

Vorbereitung der Wissensbasis

Der erste Schritt besteht darin, eine umfangreiche Sammlung von Texten, Datensätzen, Dokumenten oder anderen Informationsquellen bereitzustellen. Diese Sammlung dient neben dem bereits existierenden Trainingsdatensatz des LLM als Wissensbasis, auf die das RAG-Modell zurückgreifen kann, um relevante Informationen abzurufen. Die Datenquellen können aus Datenbanken, Dokumentablagen oder anderen externen Quellen stammen.

Die Wirksamkeit eines RAG-Systems hängt stark von der Qualität und Verfügbarkeit der Daten ab, auf die es zugreift. Unvollständige oder fehlerhafte Daten können die Ergebnisse beeinträchtigen.

Einbettung in Vektordatenbanken

Ein wichtiger Aspekt von RAG ist die Verwendung von Einbettungen (Embeddings). Einbettungen sind numerische Darstellungen von Informationen, die es maschinellen Sprachmodellen ermöglichen, ähnliche Objekte zu finden. Beispielsweise kann ein Modell, das Einbettungen verwendet, ein ähnliches Foto oder Dokument auf Basis ihrer semantischen Bedeutung finden. Diese Einbettungen werden beispielsweise in Vektordatenbanken gespeichert, die von einem KI-Modell effizient und schnell durchsucht und verstanden werden können. Um sicherzustellen, dass die Informationen stets aktuell sind, ist es wichtig, die Dokumente regelmäßig zu aktualisieren und die Vektordarstellungen entsprechend anzupassen.

Abfrage relevanter Informationen (Retrieve)

Wenn eine Benutzeranfrage gestellt wird, wird diese zunächst in eine Vektordarstellung umgewandelt und mit den vorhandenen Vektordatenbanken abgeglichen. Die Vektordatenbank sucht nach den Vektoren, die der Anfrage am ähnlichsten sind.

Erweiterung der Eingabeaufforderung (Augment)

Die abgerufenen Informationen werden mithilfe von Prompt-Engineering-Techniken in den Kontext der ursprünglichen Eingabeaufforderung eingefügt, um eine erweiterte Eingabeaufforderung zu erstellen. Diese umfasst sowohl die ursprüngliche Frage als auch die relevanten Daten. Dies ermöglicht es dem LLM, eine präzisere und informativere Antwort zu generieren.

Prompt-Engineering-Techniken sind Methoden und Strategien zur Gestaltung und Optimierung von Eingabeaufforderungen (Prompts) für Large Language Models (LLMs). Diese Techniken beinhalten die sorgfältige Formulierung und Strukturierung von Prompts, um die gewünschten Antworten und Reaktionen des Modells zu erzielen.

Antwortgenerierung (Generate)

Nachdem das RAG-Modell die relevanten Informationen gefunden hat, folgt die Generierung der Antwort. Das Modell nimmt die gefundenen Informationen und verwendet diese, um eine Antwort in natürlicher Sprache zu generieren. Dabei nutzt es Techniken der natürlichen Sprachverarbeitung, wie zum Beispiel GPT-3, um die Daten in unsere Sprache zu „übersetzen“.

GPTs (Generative Pre-trained Transformers) verwenden die Transformer-Architektur und werden darauf trainiert, menschliche Sprache zu verstehen und zu generieren. Das Modell wird vorab auf einer großen Menge an Textdaten trainiert (Pre-training) und anschließend für spezifische Aufgaben angepasst (Fine-tuning).

Was sind die Vorteile von RAG?

Die Implementierung von Retrieval-Augmented Generation bietet Ihrem Unternehmen zahlreiche Vorteile, darunter:

Effizienzsteigerung

Zeit ist Geld – besonders für Unternehmen, die nur begrenzte Ressourcen zur Verfügung haben. RAG ist effizienter als große generative Modelle, weil es in der ersten Phase nur die relevantesten Daten auswählt und dadurch die Menge an Informationen reduziert, die in der Generierungsphase verarbeitet werden müssen.

Kosteneinsparungen

Die Implementierung von RAG kann zu erheblichen Kosteneinsparungen führen. Durch die Automatisierung von Routineaufgaben und die Reduzierung manueller Recherchen können Personalkosten gesenkt und gleichzeitig die Qualität der Ergebnisse verbessert werden. Die Implementierungskosten für RAG sind zudem geringer als die für häufiges Retraining von LLMs.

Bereitstellung aktueller Informationen

RAG ermöglicht es, stets die neuesten Informationen bereitzustellen, indem es das LLM mit Live-Feeds aus sozialen Medien, Nachrichtenseiten und anderen regelmäßig aktualisierten Quellen verbindet. Dies stellt sicher, dass Sie immer die aktuellen und relevantesten Informationen erhalten.

Schnellere Reaktion auf Marktveränderungen

Unternehmen, die schneller und präziser auf Marktveränderungen und Kundenbedürfnisse reagieren können, haben bessere Chancen, sich gegenüber der Konkurrenz zu behaupten. Durch den schnellen Zugang zu relevanten Informationen und proaktive Kundenbetreuung können Unternehmen sich abheben.

Entwicklungs- und Testmöglichkeiten

Durch die Kontrolle und Anpassung der Informationsquellen des LLM können Sie das System flexibel auf sich ändernde Anforderungen oder funktionsübergreifende Nutzung abstimmen. Zudem lässt sich der Zugriff auf vertrauliche Informationen auf verschiedene Autorisierungsstufen beschränken und sicherstellen, dass das LLM angemessene Antworten generiert. Bei falschen Antworten kann RAG verwendet werden, um gezielt Fehler zu beheben und Korrekturen vorzunehmen, wenn das LLM auf ungenaue Informationsquellen verweist.

Was sind die Einsatzgebiete von Retrieval-Augmented Generation?

RAG kann in zahlreichen Geschäftsbereichen zur Optimierung der Prozesse eingesetzt werden:

- Verbesserung des Kundenservice: Im Kundenservice ist die schnelle und genaue Beantwortung von Kundenanfragen entscheidend. RAG kann hier helfen, indem es relevante Informationen aus einer umfangreichen Wissensdatenbank abruft und sofortige Antworten auf Kundenanfragen in Live-Chats ermöglicht, ohne lange Wartezeiten zu verursachen. Dies entlastet das Support-Team und erhöht die Kundenzufriedenheit.

- Wissensmanagement: RAG unterstützt das Wissensmanagement, indem es Mitarbeitenden ermöglicht, schnell auf relevante Informationen zuzugreifen, ohne sich durch etliche Ordner suchen zu müssen.

- Einarbeitung von neuen Mitarbeitenden: Neue Mitarbeitende können sich schneller einarbeiten, da sie leichter auf alle notwendigen Informationen zugreifen können. Egal ob es sich um technische Handbücher, Schulungsunterlagen oder interne Richtlinien handelt, RAG macht es einfach, die benötigten Informationen zu finden und zu nutzen.

- Content-Erstellung: RAG kann Unternehmen bei der Erstellung von Blogbeiträgen, Artikeln, Produktbeschreibung oder anderen Inhalten unterstützen, indem es seine Fähigkeit zur Textgenerierung mit dem Abrufen von Informationen aus vertrauenswürdigen internen und externen Quellen kombiniert.

- Marktforschung: RAG kann in der Marktforschung eingesetzt werden, um schnell und präzise relevante Marktdaten und Trends abzurufen. Dies erleichtert die Analyse und das Verständnis von Marktbewegungen und dem Verhalten von Kunden und Kundinnen.

- Produktion: In der Produktion kann RAG zur Verbrauchsvorhersage und zur automatisierten Personaleinsatzplanung basierend auf Erfahrungen der Vergangenheit genutzt werden. Dies hilft dabei, Ressourcen effizienter zu nutzen und die Produktionsplanung zu optimieren.

- Vertrieb von Produkten: RAG kann die Vertriebsproduktivität steigern, indem es Vertriebsmitarbeitenden hilft, schnell relevante Produktinformationen abzurufen und Kunden und Kundinnen gezielt Empfehlungen zu geben. Dies verbessert die Effizienz im Vertrieb und kann zu einer höheren Kundenzufriedenheit und Umsatzsteigerung führen.

- 100 % DSGVO-konform und sicher in Deutschland gehostet

- Die leistungsstärksten KI-Modelle auf einer Plattform

- Kein Vendor Lock-in durch Open Source

Tipps zur Implementierung von Retrieval-Augmented Generation

Nachdem Sie nun die zahlreichen Vorteile und Einsatzgebiete von Retrieval-Augmented Generation (RAG) kennengelernt haben, stellt sich die Frage: Wie können Sie diese Technologie in Ihrem Betrieb implementieren? Der erste Schritt besteht darin, den spezifischen Bedarf Ihres Unternehmens zu analysieren. Überlegen Sie, in welchen Bereichen RAG den größten Nutzen bringen könnte. Dies könnte der Kundenservice, das Wissensmanagement oder das Marketing sein. Definieren Sie klare Ziele, die Sie mit der Implementierung von RAG erreichen möchten, z. B. die Reduzierung der Antwortzeiten im Kundenservice.

Es gibt verschiedene Anbieter und Plattformen, die RAG-Technologien anbieten. Recherchieren Sie gründlich und wählen Sie eine Lösung, die am besten zu den Bedürfnissen Ihres Unternehmens passt. Achten Sie dabei auf Faktoren wie Benutzerfreundlichkeit, Integrationsfähigkeit mit bestehenden Systemen, Skalierbarkeit und natürlich die Kosten.

Nachdem Sie eine geeignete RAG-Lösung ausgewählt haben, müssen Sie diese in Ihre bestehenden Systeme und Arbeitsabläufe integrieren. Dies kann die Anbindung an Ihre Datenbanken, CRM-Systeme oder anderen Software-Lösungen umfassen. Eine nahtlose Integration ist entscheidend, um den maximalen Nutzen aus der RAG-Technologie zu ziehen und den Betrieb nicht zu stören. Bieten Sie Schulungen und Unterstützung an, um den Übergang so reibungslos wie möglich zu gestalten. Ein gut geschultes Team kann die Vorteile von RAG besser nutzen und eventuelle Probleme schneller lösen.

Nach der Implementierung ist es wichtig, die Leistung der RAG-Lösung kontinuierlich zu überwachen. Analysieren Sie regelmäßig die Ergebnisse und suchen Sie nach Möglichkeiten zur Optimierung. Stellen Sie sicher, dass alle Daten, die von der Retrieval-Augmented-Generation-Technologie verarbeitet werden, sicher und gemäß den geltenden Datenschutzbestimmungen behandelt werden. Dies schützt nicht nur Ihre Kundschaft und Ihr Unternehmen, sondern stärkt auch das Vertrauen in Ihre digitale Transformation.